Twitter-skermkiekies / Unsplash, skrywer met dien verstande

Twitter het die naweek 'n video "gemerk" as 'n gemanipuleerde video waarin die Amerikaanse Demokratiese presidentskandidaat Joe Biden vermoedelik vergeet het in watter staat hy was terwyl hy 'n skare toegespreek het.

Biden se “hallo Minnesota” -groet is gekontrasteer met prominente tekens wat lees “Tampa, Florida” en “SMS FL na 30330”.

Associated Press se feitekontrole bevestig die bordjies is digitaal bygevoeg en die oorspronklike beeldmateriaal is inderdaad afkomstig van 'n Minnesota-saamtrek. Maar toe die misleidende video verwyder is, het dit al meer as een miljoen keer gekyk, The Guardian verslae.

'N ONWAAR video wat beweer dat Biden vergeet het in watter toestand hy hom bevind het, is die afgelope 1 uur meer as 24 miljoen keer op Twitter gekyk

- Donie O'Sullivan (@donie) November 1, 2020

In die video sê Biden "Hallo, Minnesota."

Die gebeurtenis het inderdaad in MN plaasgevind - bordjies op die verhoog lees MN

Maar vals video wysig tekens om Florida te lees pic.twitter.com/LdHQVaky8v

As u sosiale media gebruik, is die kans groot dat u die meer as sien (en aanstuur) 3.2 miljard beelde en 720,000 uur van video daagliks gedeel. Hoe kan ons weet wat werklik is en wat nie as ons voor so 'n groot hoeveelheid inhoud te staan kom nie?

Alhoewel een deel van die oplossing 'n groter gebruik van instrumente vir inhoudverifiëring is, is dit net so belangrik dat ons almal ons digitale mediageletterdheid sal verhoog. Uiteindelik is jy een van die beste verdedigingslinies - en die enigste wat jy kan beheer.

Sien moet nie altyd glo nie

Verkeerde inligting (as u per ongeluk vals inhoud deel) en disinformasie (as u dit opsetlik deel) in enige medium kan vertroue in burgerlike instellings ondermyn soos nuusorganisasies, koalisies en sosiale bewegings. Valse foto's en video's is egter dikwels die sterkste.

Vir diegene met 'n gevestigde politieke belang kan die skep, deel en / of redigering van valse beelde kykers se aandag aftrek, verwar en manipuleer om onmin en onsekerheid te saai (veral in reeds gepolariseerde omgewings). Plakkate en platforms kan ook geld verdien uit die deel van valse, sensasionele inhoud.

Net 11-25% volgens die Internasionale Sentrum vir Joernaliste wêreldwyd gebruik instrumente vir die verifikasie van sosiale media-inhoud.

Kan u 'n gedokterde beeld raaksien?

Beskou hierdie foto van Martin Luther King Jr.

Dr Martin Luther King Jr. Gee die middelvinger #DopeHistoricPics pic.twitter.com/5W38DRaLHr

- Dope Historic Pics (@dopehistoricpic) Desember 20, 2013

dit veranderde beeld klone 'n deel van die agtergrond oor King Jr se vinger, so dit lyk asof hy van die kamera af wegslaan. Dit is as eg op gedeel Twitter, reddit en wit supremacist webwerwe.

In die oorspronklike Op die foto van 1964 flits King die teken "V for winning" nadat hy verneem het dat die Amerikaanse senaat die wetsontwerp op burgerregte aanvaar het.

'Diegene wat van vrede hou, moet leer om net so effektief te organiseer soos diegene wat oorlog liefhet.'

- Willie's Reserve (@WilliesReserve) 21 Januarie 2019

Dr. Martin Luther King Jr.

??

Hierdie foto is op 19 Junie 1964 geneem, waarop Dr. King 'n vredesteken gee nadat hy gehoor het dat die wetsontwerp op burgerregte die senaat deurgevoer het. @ snope pic.twitter.com/LXHmwMYZS5

Behalwe dat elemente bygevoeg of verwyder word, is daar 'n hele kategorie fotomanipulasie waarin beelde saamgevoeg word.

Vroeër vanjaar, a foto van 'n gewapende man is deur 'n fotoshopping Fox News, wat die man op ander tonele oorgetrek het sonder om die wysigings bekend te maak, die Seattle Times berig.

Bedoel jy hierdie man wat in drie afsonderlike foto's wat deur Fox News uitgereik is, gefotoshop is? pic.twitter.com/fAXpIKu77a

— Zander Yates ???????? ???? ???????? (@ZanderYates) Junie 13, 2020

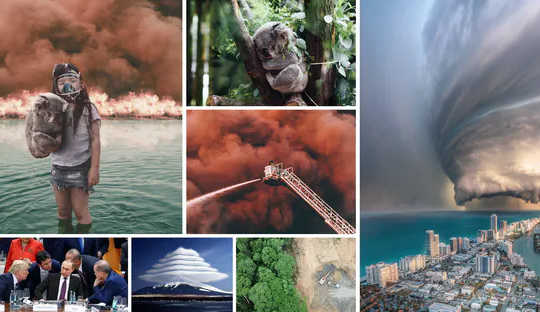

Net so, die beeld hieronder is duisende kere in die sosiale media in Januarie tydens die Swart Somer-bosbrande op sosiale media gedeel. Die AFP se feitekontrole bevestig dit is nie outentiek nie en is eintlik 'n kombinasie van verskeie afsonderlike foto's.

Beeld is kragtiger as gil van Greta. 'N Stil meisie hou 'n koala vas. Sy kyk reguit na jou uit die waters van die see waar hulle 'n toevlug gevind het. Sy dra 'n asemmasker. 'N Muur van vuur is agter hulle. Ek weet nie wat die naam van die fotograaf is nie #Australia pic.twitter.com/CrTX3lltdh

- EVC Musiek (@EVCMusicUK) 6 Januarie 2020

Volledige en gedeeltelike sintetiese inhoud

Aanlyn sal jy ook gesofistikeerde “deepfake”Video's wat (gewoonlik bekende) mense wys of dinge sê of doen wat hulle nooit gedoen het nie. Minder gevorderde weergawes kan met behulp van programme geskep word soos Zao en Herbeweeg.

{vembed Y = yaq4sWFvnAY}

'N Span van die Massachusetts Institute of Technology het hierdie vals video geskep waarin die Amerikaanse president Richard Nixon reëls lees uit 'n toespraak wat gemaak is in geval die maanlanding van 1969 sou misluk. (Youtube)

Of, as u nie u foto vir 'n profielfoto wil gebruik nie, kan u een van die verskillende standaarde gebruik webtuistes bied honderdduisende foto-realistiese beelde van mense wat deur KI gegenereer word.

Hierdie mense bestaan nie, dit is net beelde wat gegenereer word deur kunsmatige intelligensie. Gegenereerde foto's, CC BY

Die wysiging van pixelwaardes en die (nie so nie) eenvoudige sny

Om te sny, kan ook die konteks van 'n foto aansienlik verander.

Ons het dit gesien in 2017, toe 'n Amerikaanse regeringswerknemer amptelike foto's van Donald Trump se inhuldiging geredigeer het om die skare groter te laat vertoon, volgens The Guardian. Die personeellid het die leë ruimte "waar die skare eindig" uitgesny vir 'n stel foto's vir Trump.

Uitsig oor die skare tydens die inhuldiging van die voormalige Amerikaanse president Barack Obama in 2009 (links) en president Donald Trump in 2017 (regs). AP

Uitsig oor die skare tydens die inhuldiging van die voormalige Amerikaanse president Barack Obama in 2009 (links) en president Donald Trump in 2017 (regs). AP

Maar wat van wysigings wat net pixelwaardes soos kleur, versadiging of kontras verander?

Een historiese voorbeeld illustreer die gevolge hiervan. In 1994 het die tydskrif Time dekking van OJ Simpson aansienlik "verduister" Simpson in sy polisie mugshot. Dit het brandstof gevoeg in 'n saak wat reeds deur rassespanning geteister word, waarop die tydskrif gereageer:

Geen rasse-implikasies was bedoel deur Time of deur die kunstenaar nie.

U dink miskien aan hierdie kontroversie uit 1994. Die tydskrif Time het 'n hoop probleme gekry om OJ Simpson se mokshot te verduister en moes die uitgawe uiteindelik terugtrek. Dit is waarskynlik die bekendste voorbeeld van so iets. En ja, ek gaan self uit, weet ek. pic.twitter.com/7U7Yw7XZGU

- Pilar Pedraza TV (@PilarPedrazaTV) November 2, 2020

Gereedskap om digitale vervalsing te ontrafel

Vir diegene onder ons wat nie mislei wil word deur visuele verkeerde / disinformasie nie, is daar instrumente beskikbaar - hoewel elkeen sy eie beperkings het (iets wat ons in ons onlangse bespreking bespreek) papier).

Invisible digitale watermerk is as oplossing voorgestel. Dit is egter nie wydverspreid nie en vereis 'n inkoop van sowel uitgewers as verspreiders.

Omgekeerde beeldsoektog (soos Google se) is dikwels gratis en kan nuttig wees om vroeër, moontlik meer outentieke kopieë van beelde aanlyn te identifiseer. Dit gesê, dit is nie dwaas nie, want dit:

- maak staat op onbewerkte eksemplare van die media wat reeds aanlyn is

- soek nie die hele web

- laat nie altyd filter op publikasietyd toe nie. Sommige omgekeerde beeldsoekdienste soos TinEye ondersteun hierdie funksie, maar Google s'n nie.

- lewer slegs presiese of amper-wedstryde op, so dit is nie deeglik nie. As u byvoorbeeld 'n beeld redigeer en dan die oriëntasie daarvan omdraai, kan dit Google mislei om te dink dat dit heeltemal anders is.

Die mees betroubare gereedskap is gevorderd

Intussen fokus manuele forensiese opsporingsmetodes vir visuele verkeerde / disinformasie meestal op wysigings wat met die blote oog sigbaar is, of vertrou op die ondersoek van funksies wat nie by elke prentjie (soos skaduwees) ingesluit word nie. Hulle is ook tydrowend, duur en benodig gespesialiseerde kundigheid.

Tog kan u toegang tot werk in hierdie veld kry deur webwerwe soos Snopes.com te besoek - wat 'n groeiende bewaarplek van "fauxtografie".

Rekenaarvisie en masjienleer bied ook relatief gevorderde opsporingsmoontlikhede vir beelde en videos. Maar ook hulle benodig tegniese kundigheid om te funksioneer en te verstaan.

Verder behels die verbetering daarvan groot hoeveelhede “opleidingsdata”, maar die beeldbewaarplekke wat hiervoor gebruik word, bevat gewoonlik nie die werklike beelde wat in die nuus gesien word nie.

As u 'n beeldverifiëringsinstrument soos die REVEAL-projek gebruik beeldverifiëringsassistent, sal u dalk 'n kundige nodig hê om die resultate te interpreteer.

Die goeie nuus is egter dat voordat u na een van die bogenoemde instrumente gaan, daar enkele eenvoudige vrae is wat u uself kan afvra om moontlik uit te vind of 'n foto of video op sosiale media vals is. Dink:

- is dit oorspronklik vir sosiale media gemaak?

- hoe wyd en hoe lank is dit versprei?

- watter antwoorde het dit ontvang?

- wie was die doelgroep?

Dikwels is die logiese gevolgtrekkings wat uit die antwoorde gemaak word, voldoende om onaantreklike beeldmateriaal uit te wis. U kan toegang kry tot die volledige lys vrae, saamgestel deur kenners van die Metropolitan Universiteit van Manchester, na hierdie skakel.![]()

Oor die outeurs

TJ Thomson, senior lektor in visuele kommunikasie en media, Queensland University of Technology; Daniel Angus, medeprofessor in digitale kommunikasie, Queensland University of Technology, en Paula Dootson, senior lektor, Queensland University of Technology

Hierdie artikel is gepubliseer vanaf Die gesprek onder 'n Creative Commons lisensie. Lees die oorspronklike artikel.